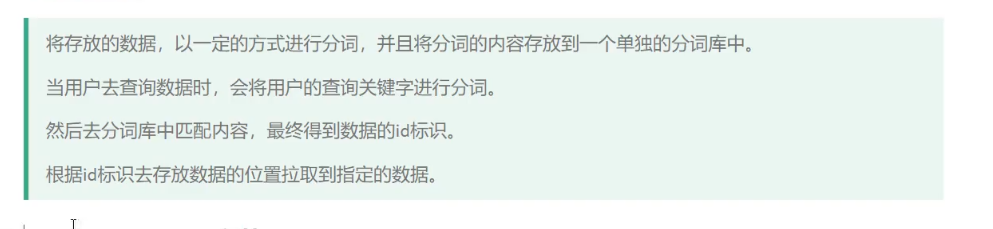

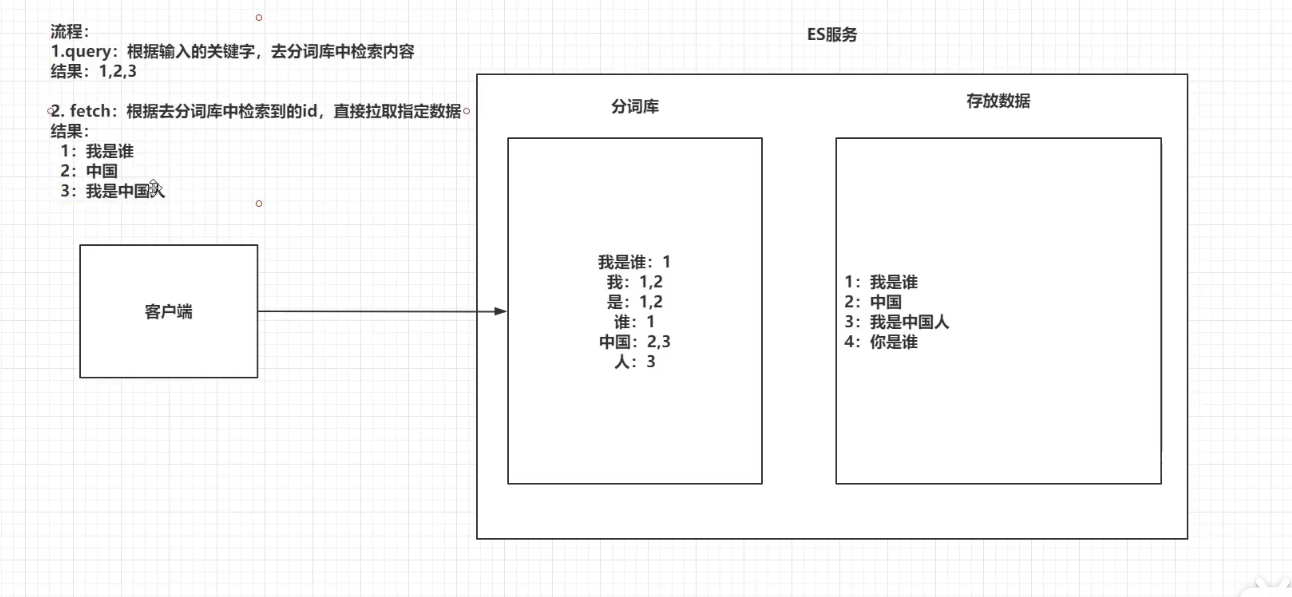

原理

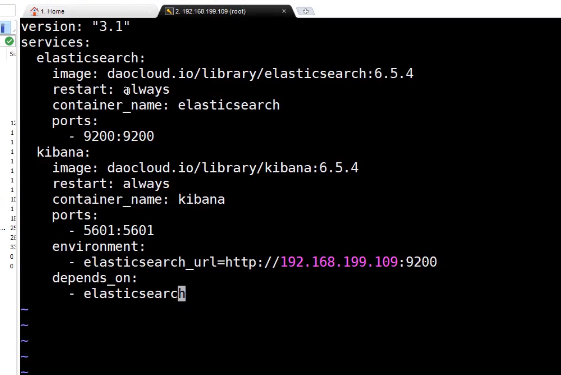

version: "3.1"

services:

elasticsearch:

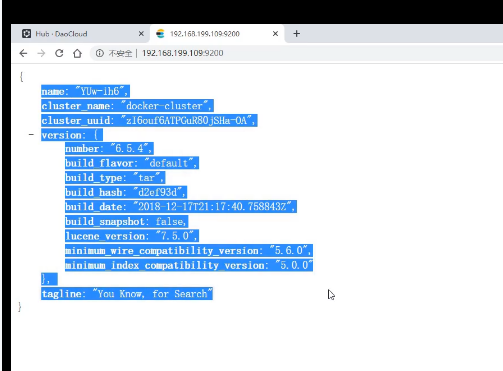

image: daocloud.io/library/elasticsearch:6.5.4

restart: always

container_name: elasticsearch

ports:

- 9200:9200

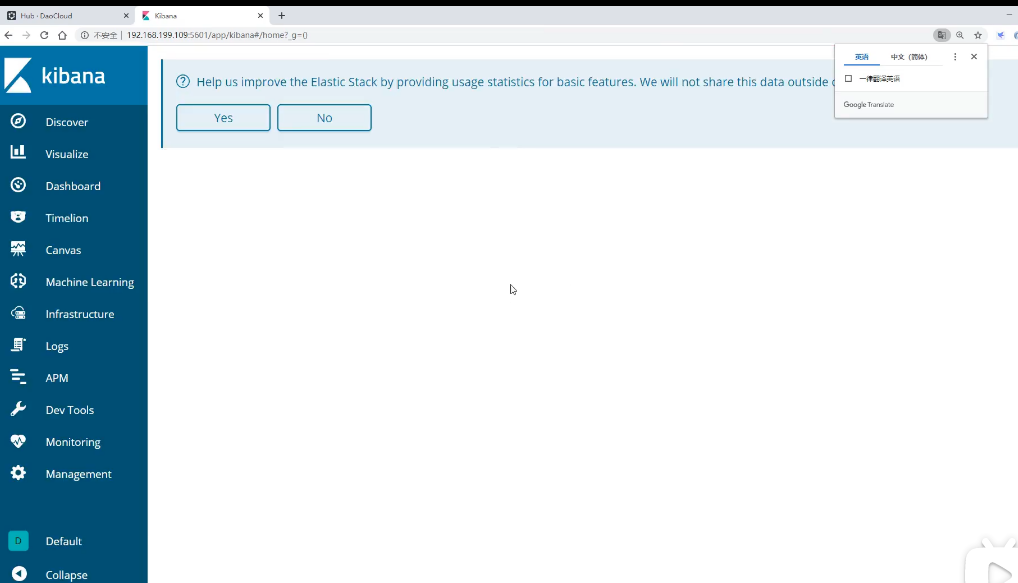

kibana:

image: daocloud.io/library/kibana:6.5.4

restart: always

container_name: kibana

ports:

- 5601:5601

environment:

- elasticsearch_url=http://192.168.137.137:9200

depends_on:

- elasticsearch

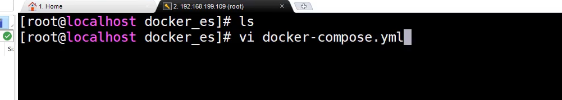

vim docker-compose.yml

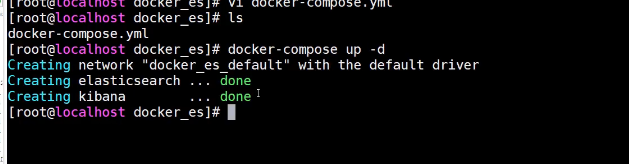

docker-compose up -d #启动容器

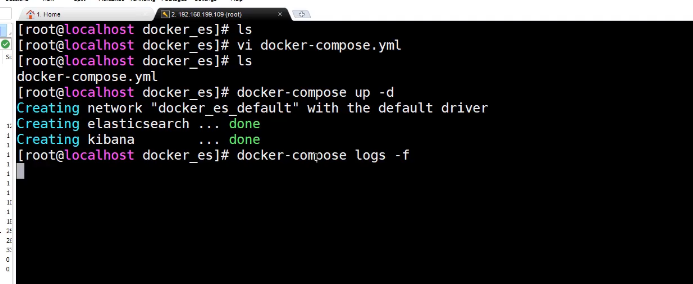

docker-compose logs -f # 查看日志

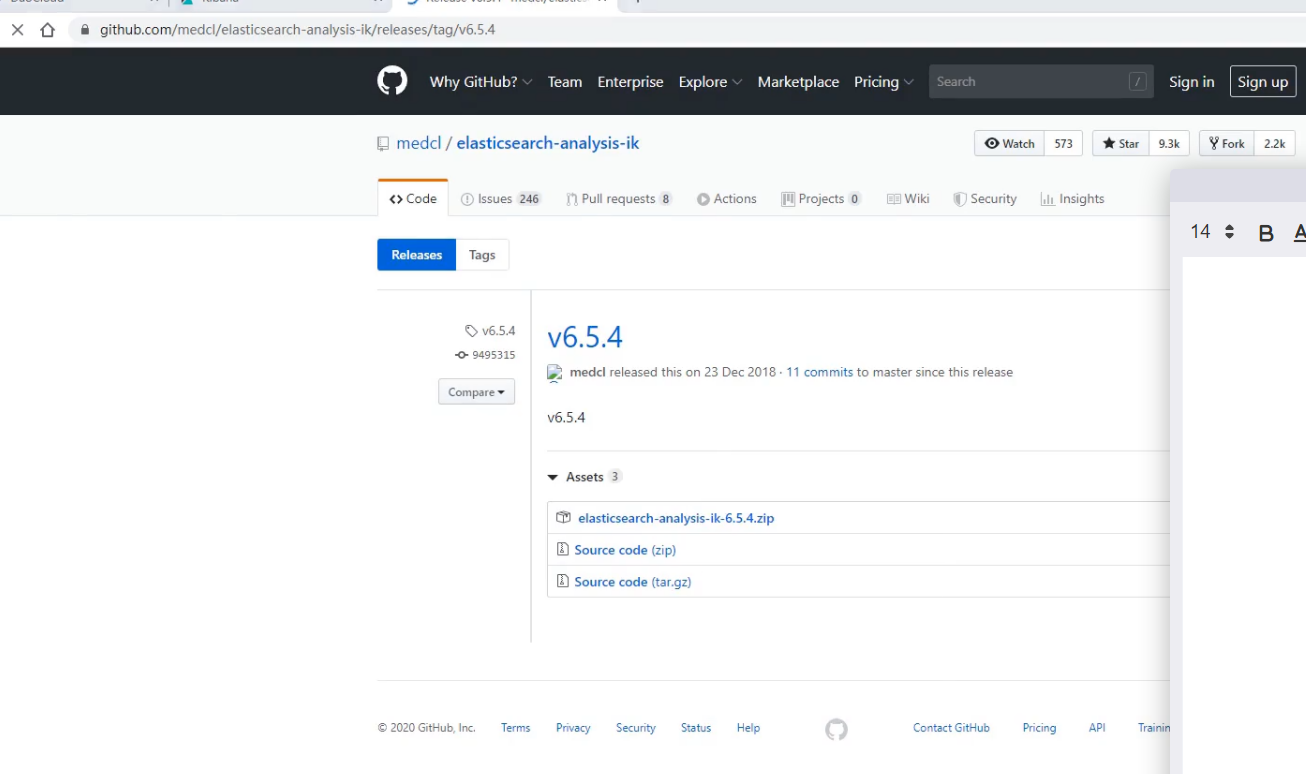

ik分词器

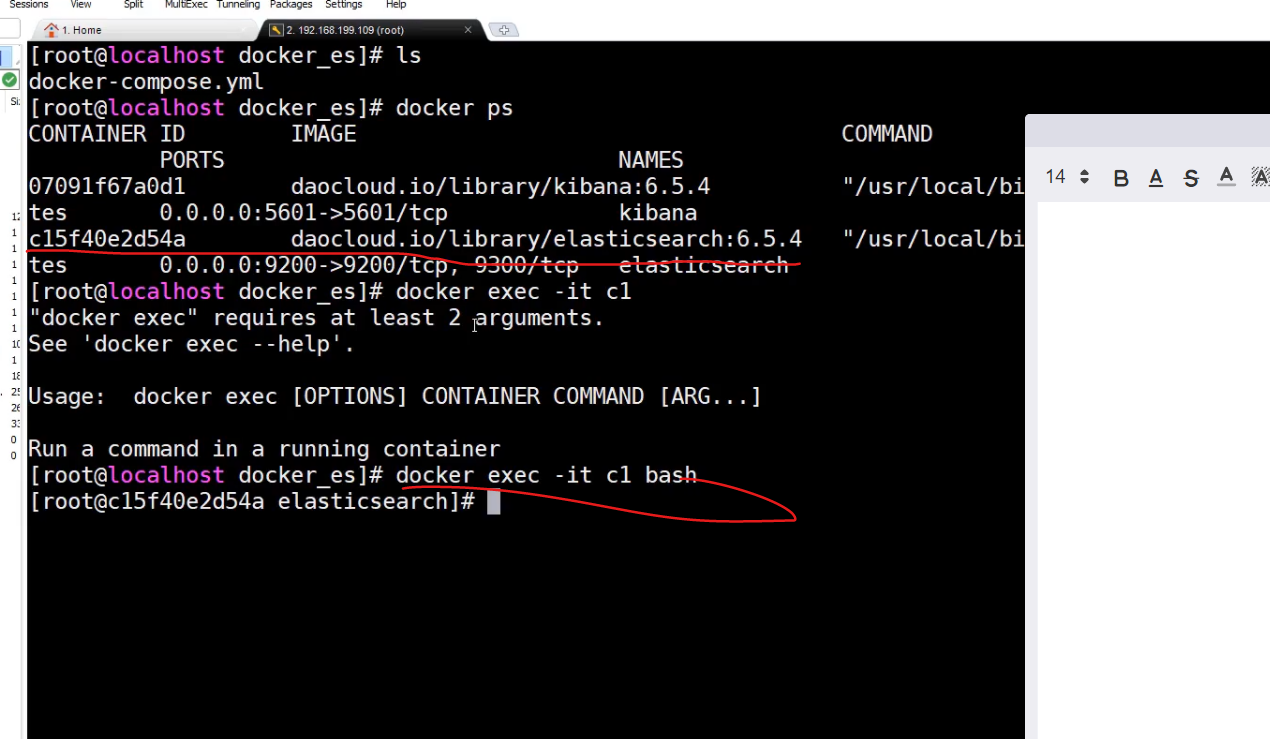

进入容器安装ik

docker exec -it cl bash #进入容器

进入到 bin下

./elasticsearch-plugin install https://github.com/..... 安装分词插件

安装分词器

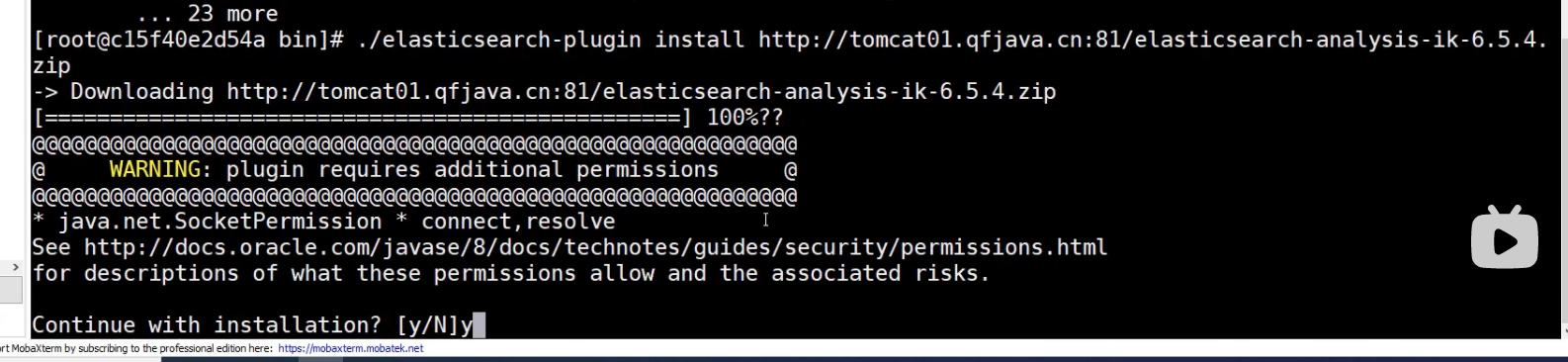

./elasticsearch-plugin install http://tomcat01.qfjava.cn:81/elasticsearch-analysis-ik-6.5.4.zip

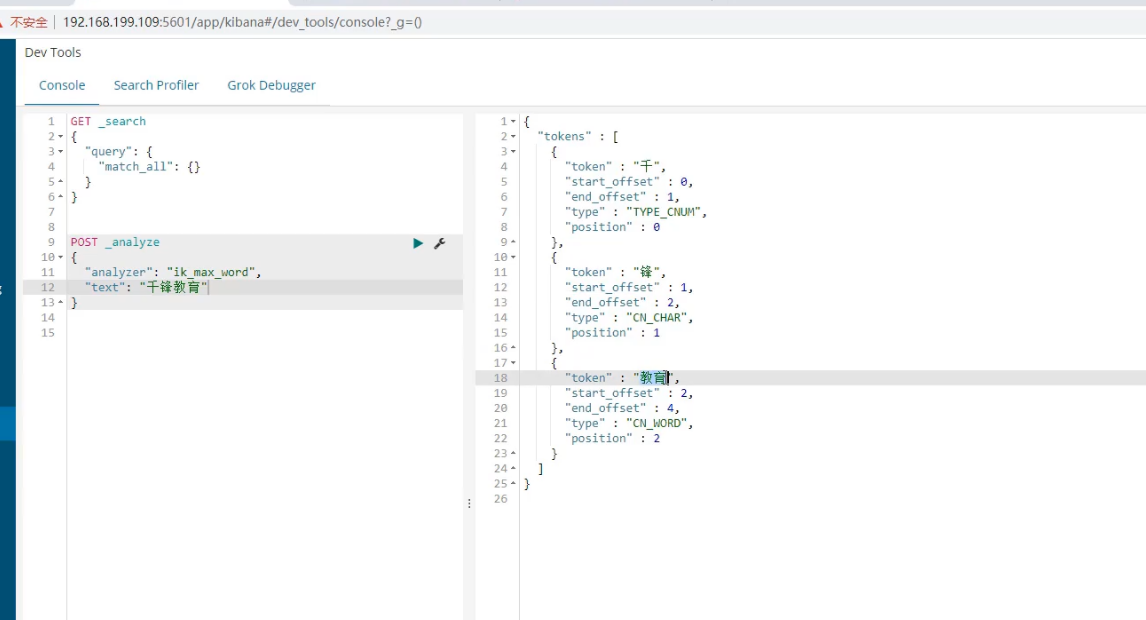

分词方式

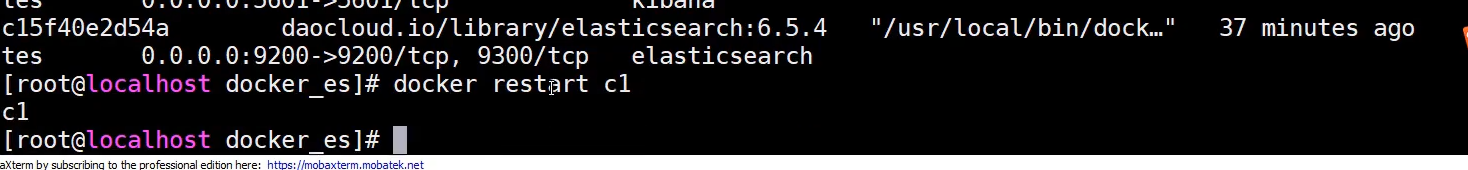

安装分词后需要重启容器

docker restart c1

查日志

docker logs -f cl

demo

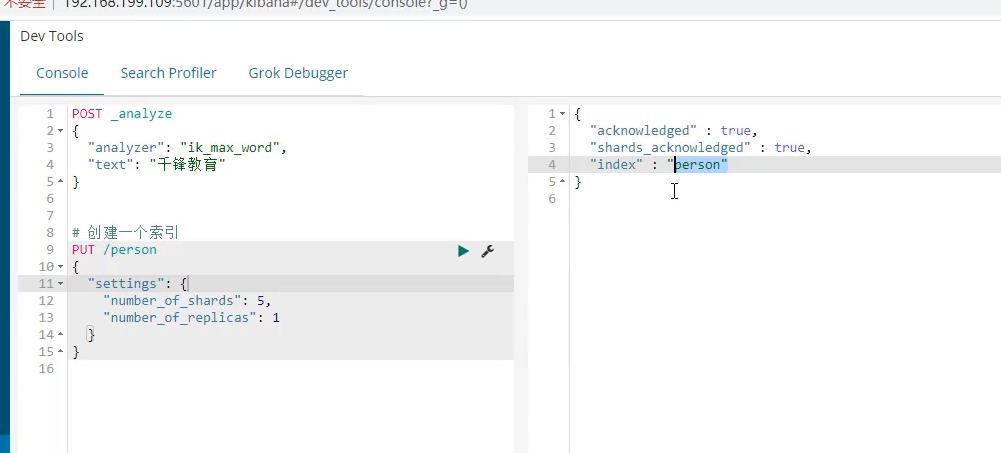

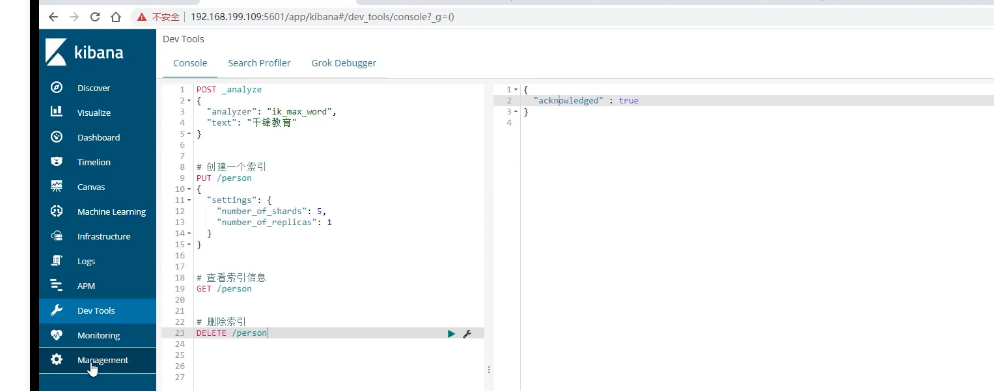

创建索引

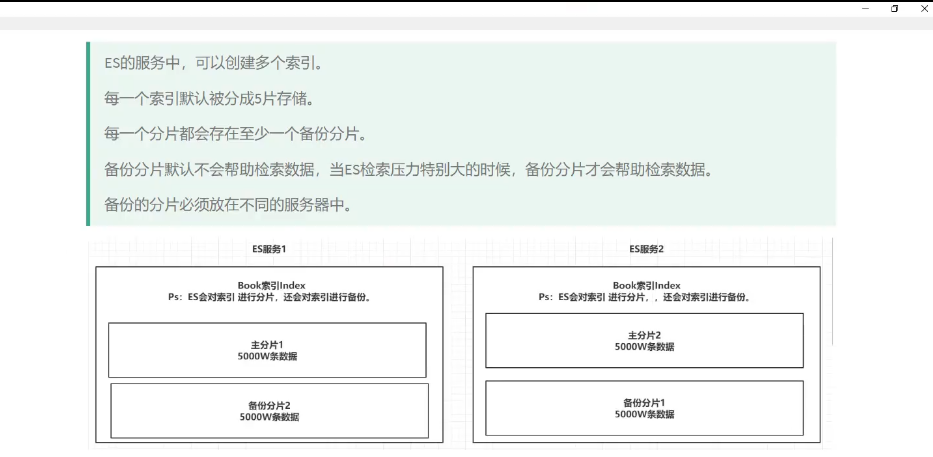

分片5个 备份一个

PUT /admin

{

"settings": {

"number_of_replicas": 1,

"number_of_shards": 5

}

}

备份分片一个 是放在其他服务器上的

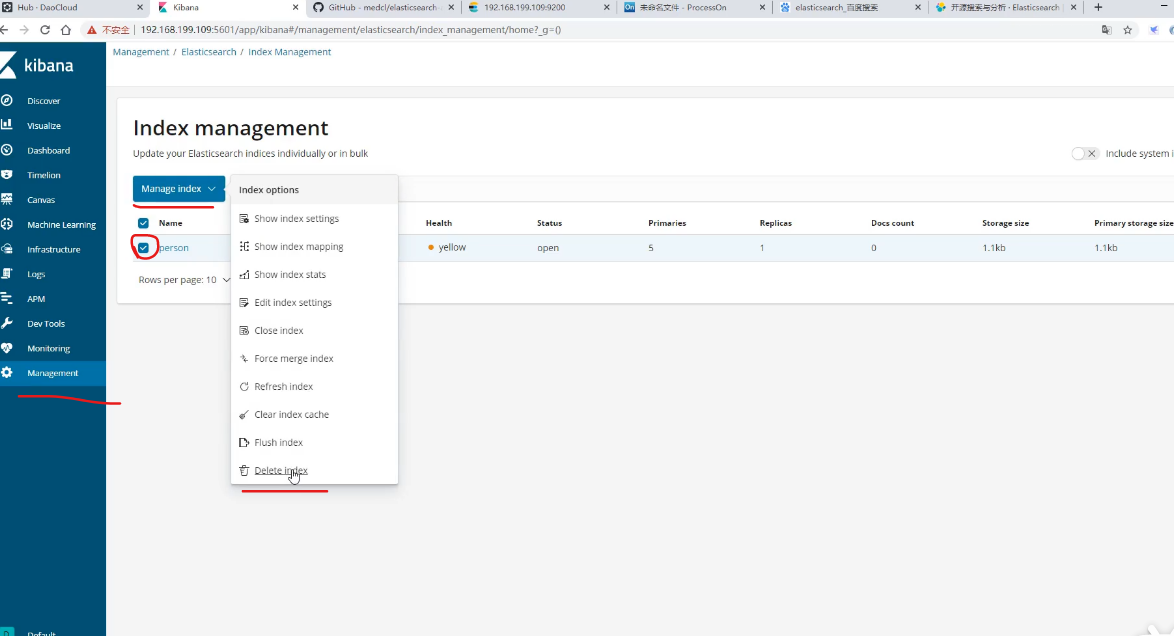

删除索引

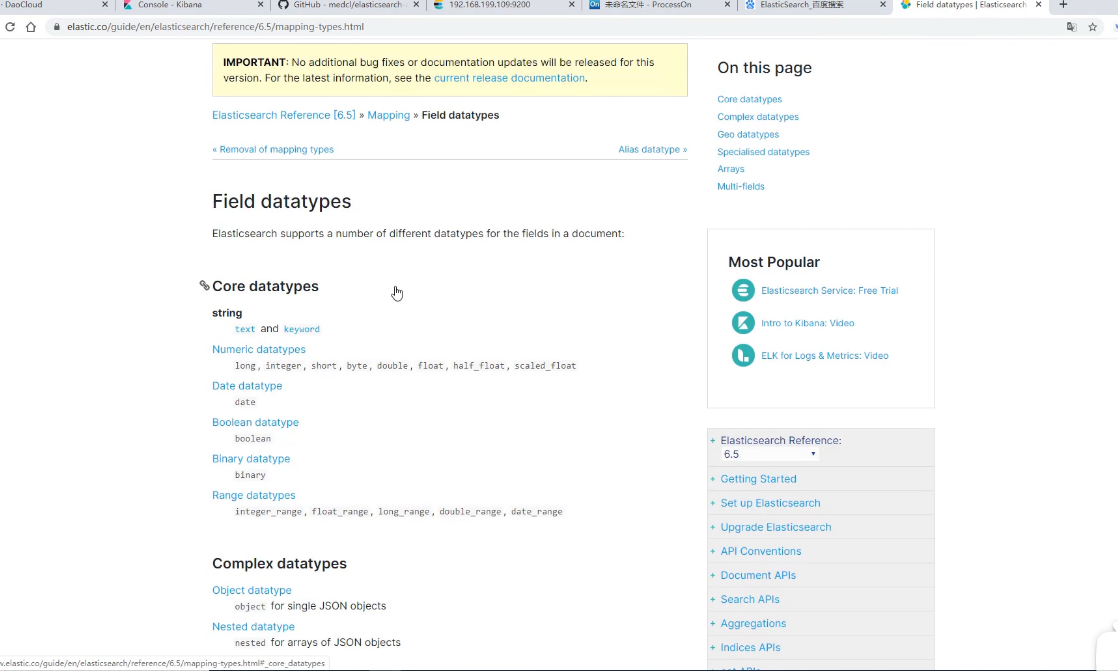

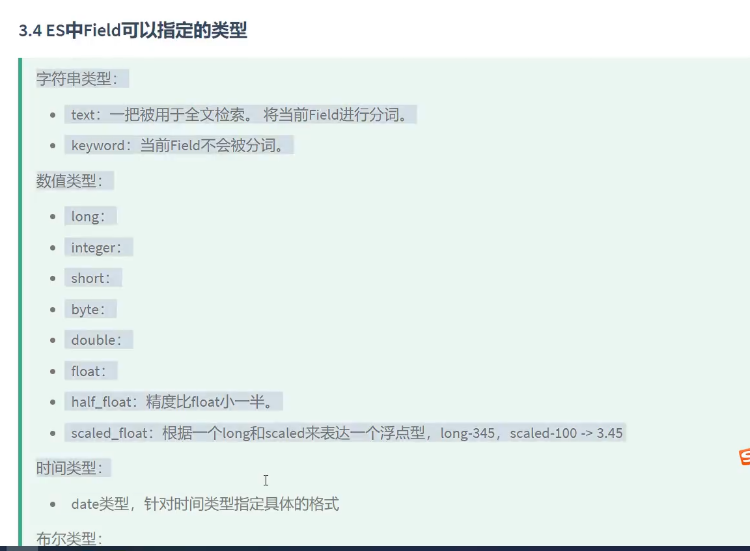

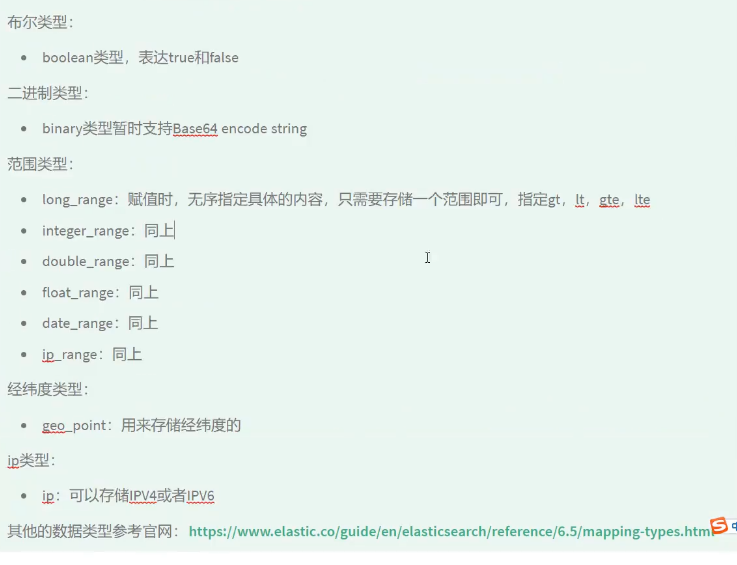

es数据类型

常用数据类型

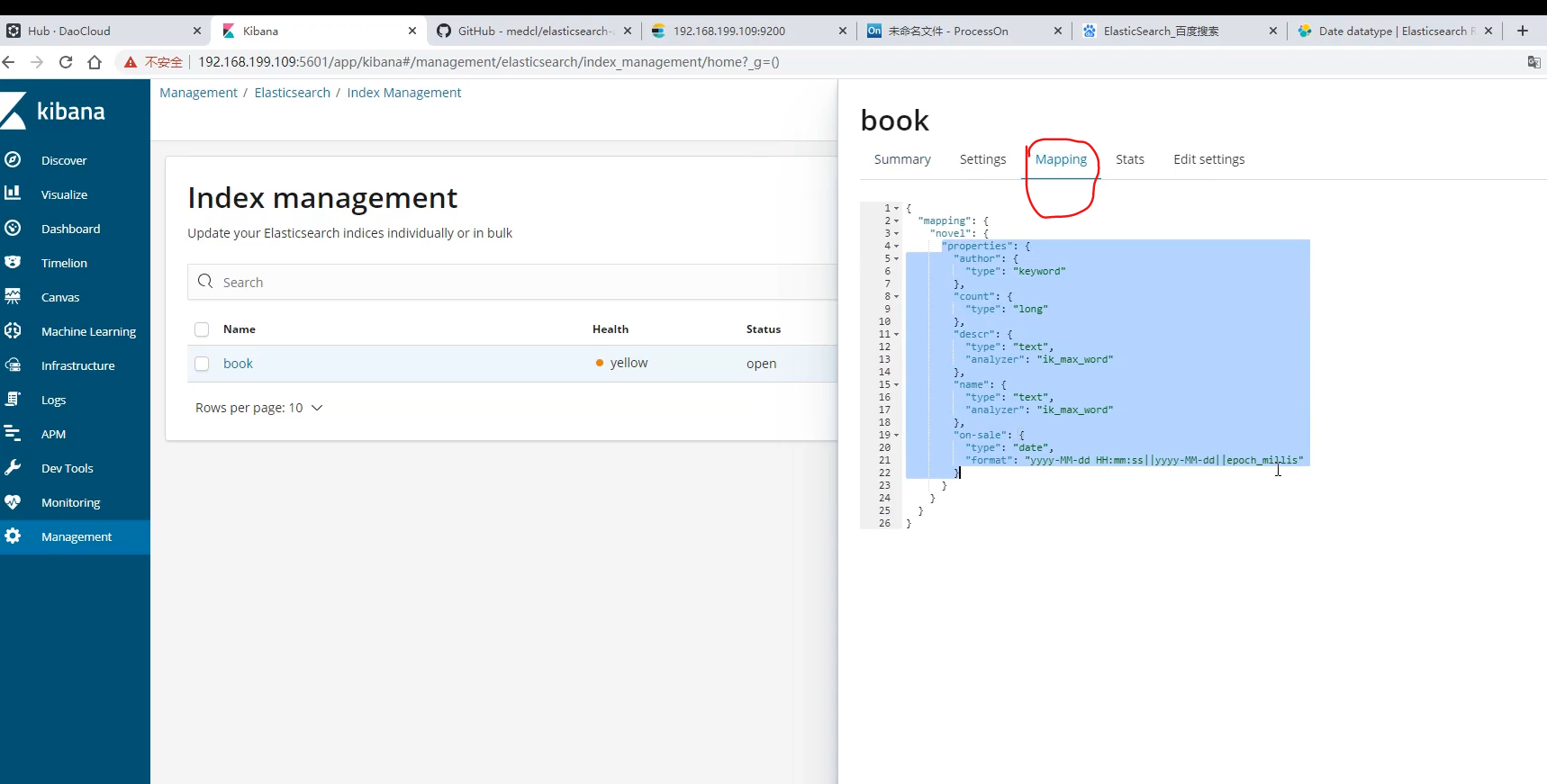

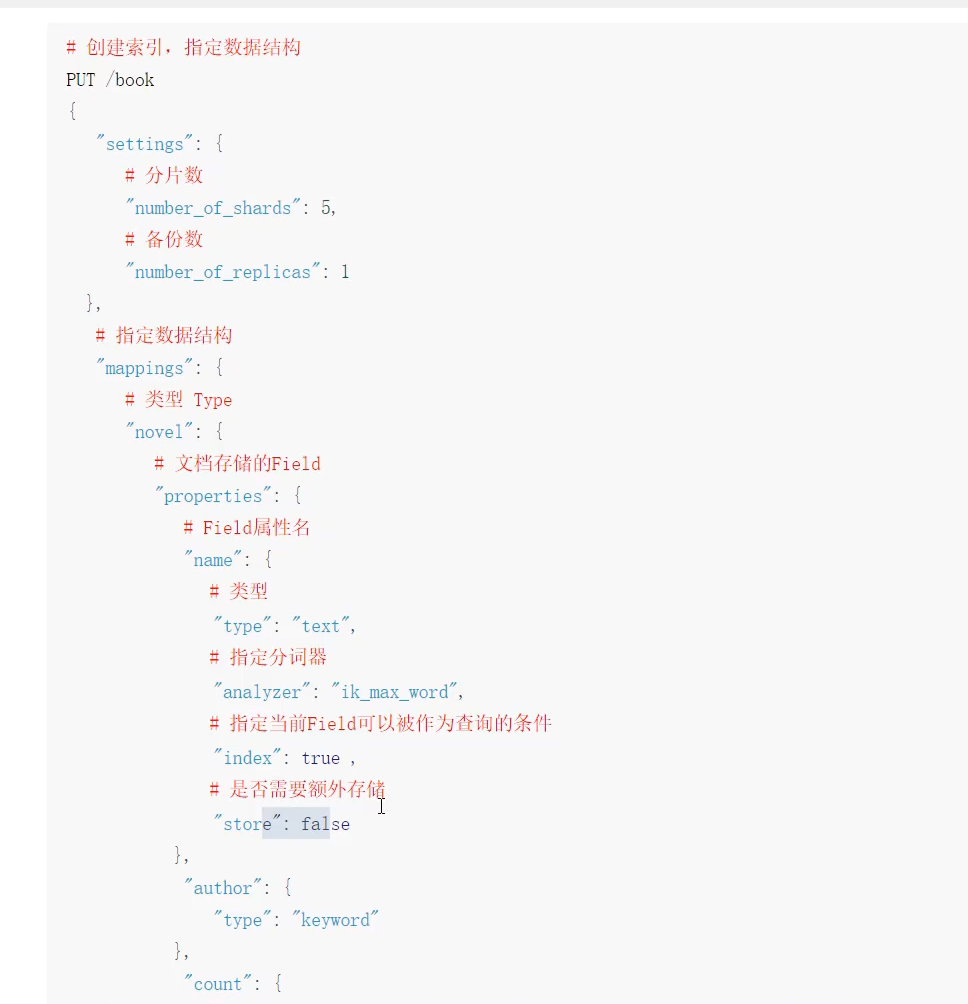

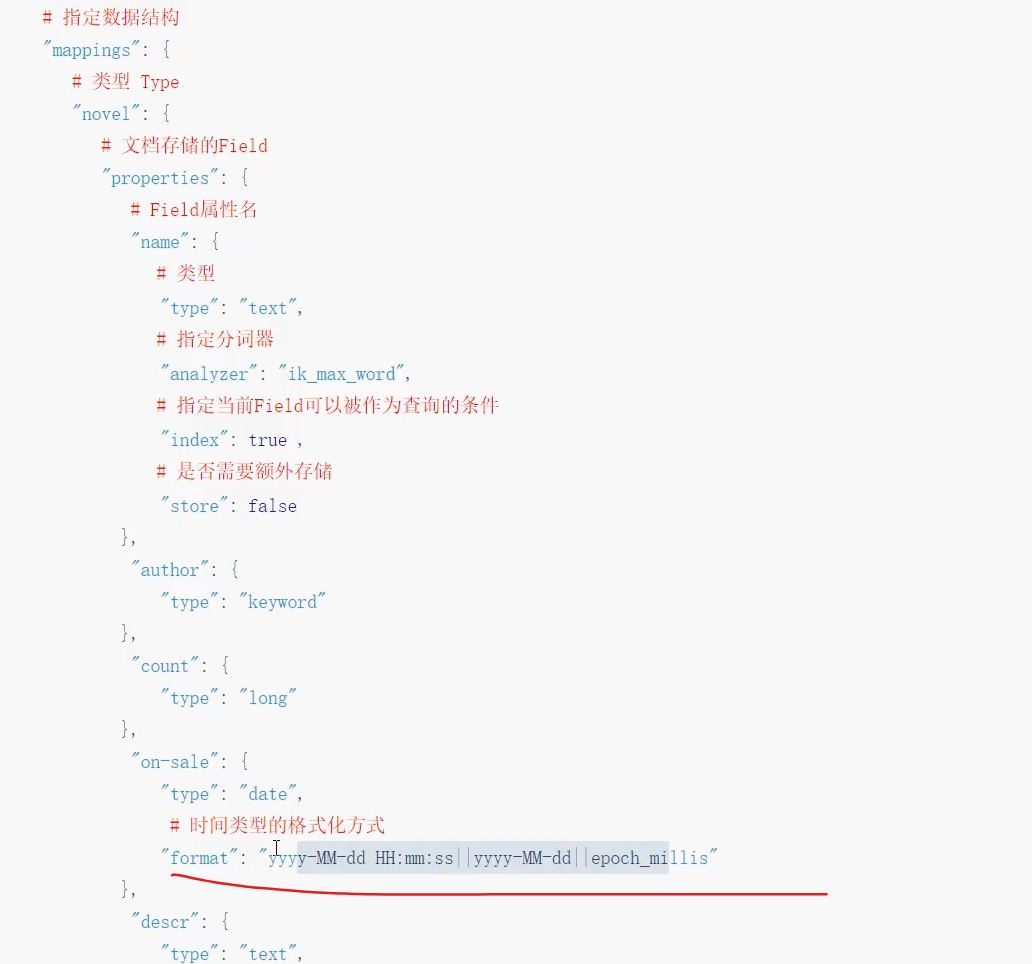

创建索引并指定结构

PUT /admin

{

"settings": {

"number_of_replicas": 1,

"number_of_shards": 5

},

"mappings": {

"admin":{

"properties":{

"id":{

"type":"keyword"

},

"name":{

"type":"text",

"analyzer":"ik_max_word"

}

}

}

}

}

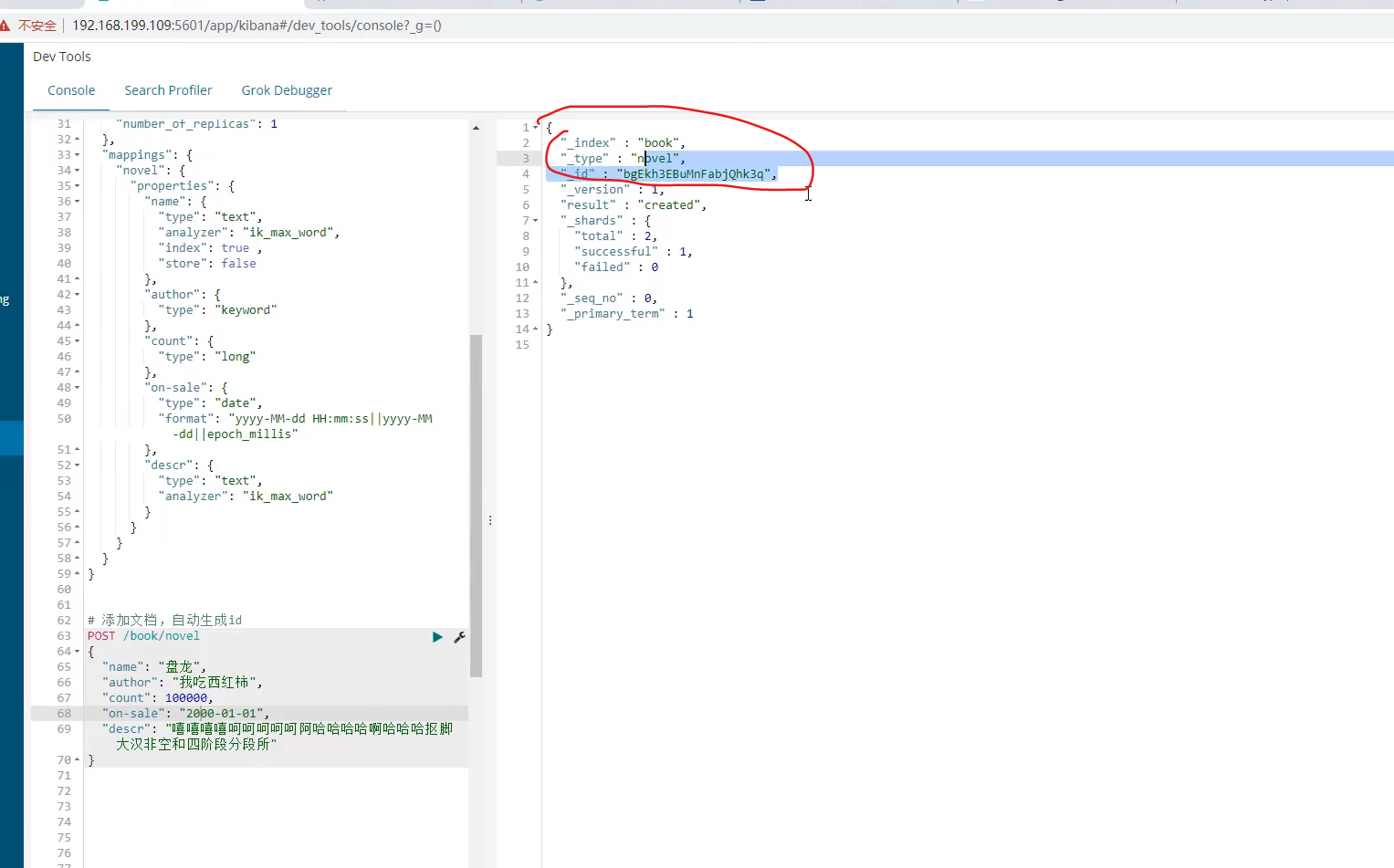

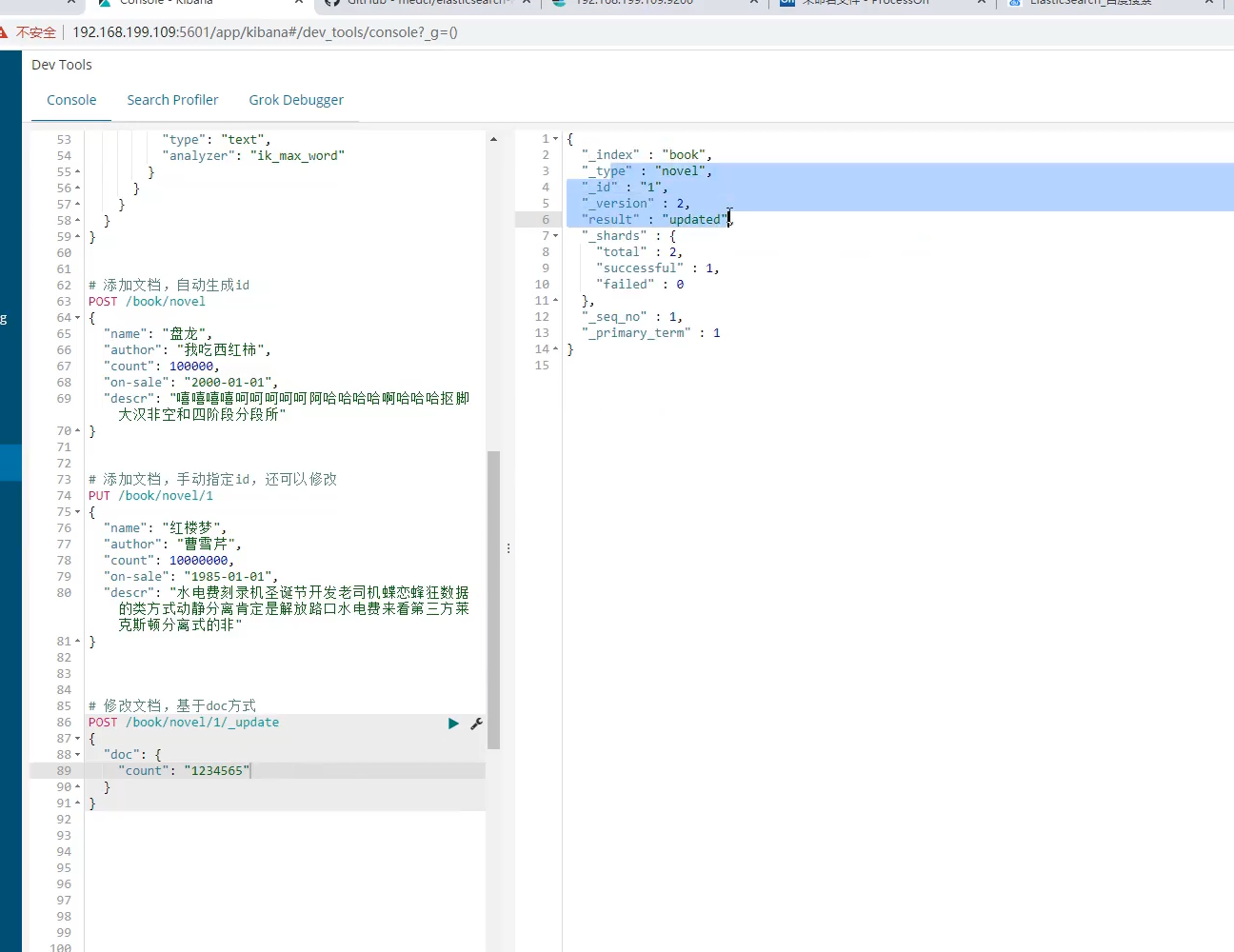

文档操作

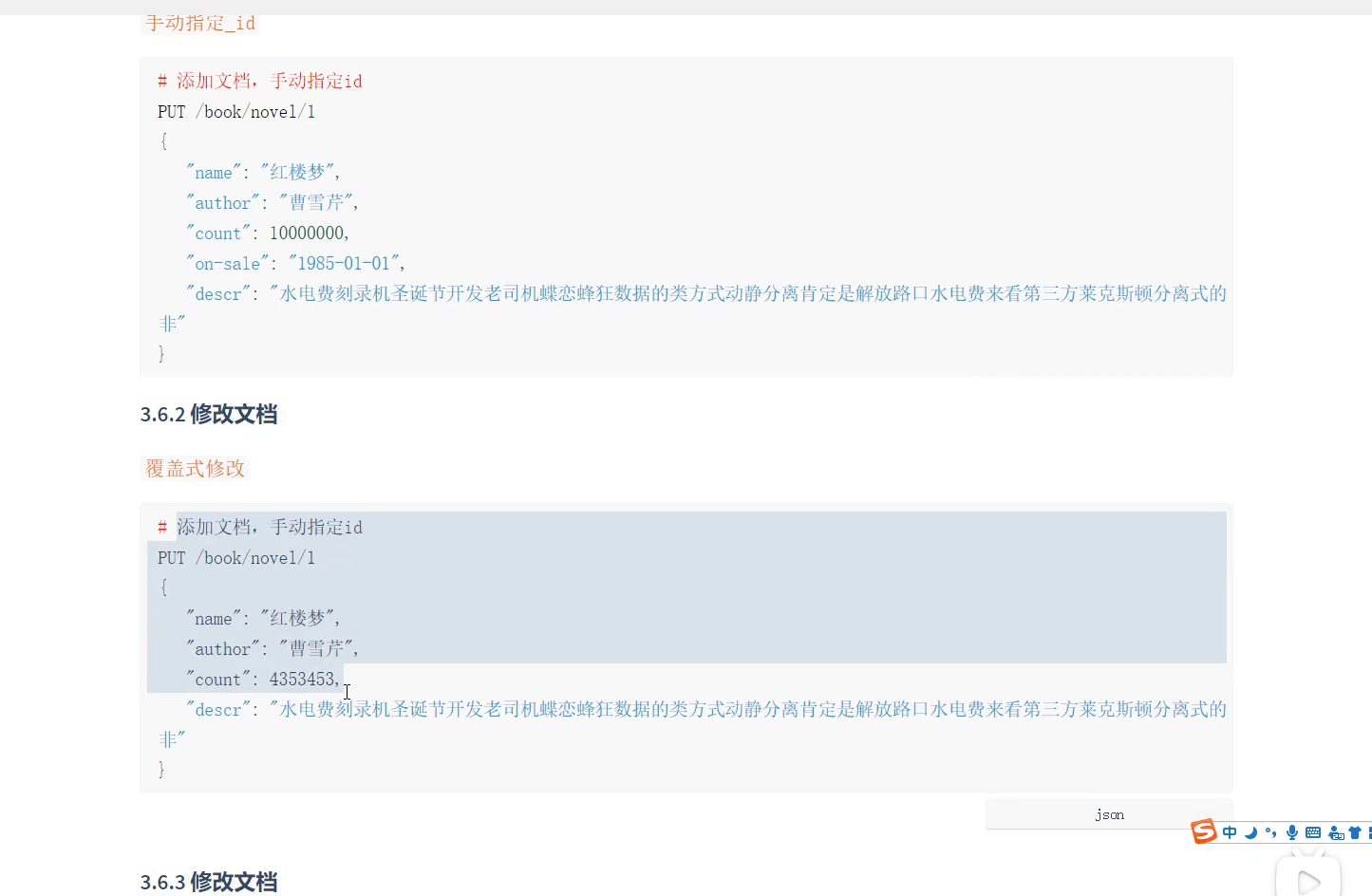

指定id

覆盖修改如果有一个没有直接是空或者0

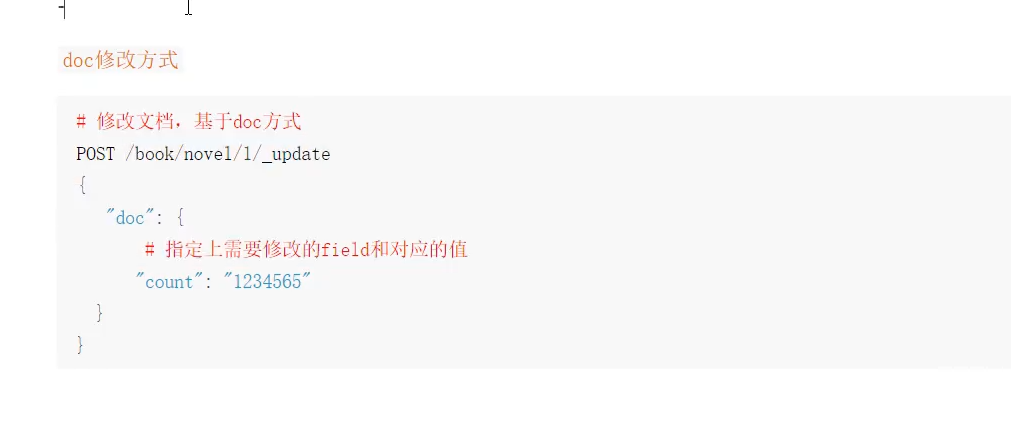

非覆盖修改

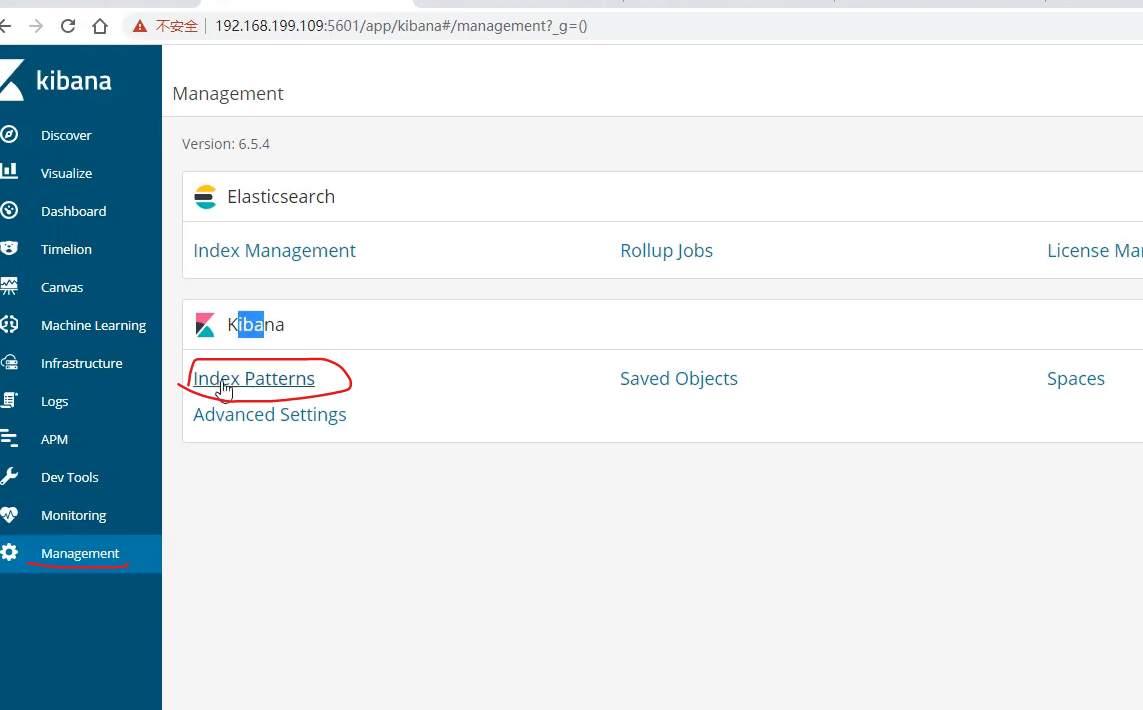

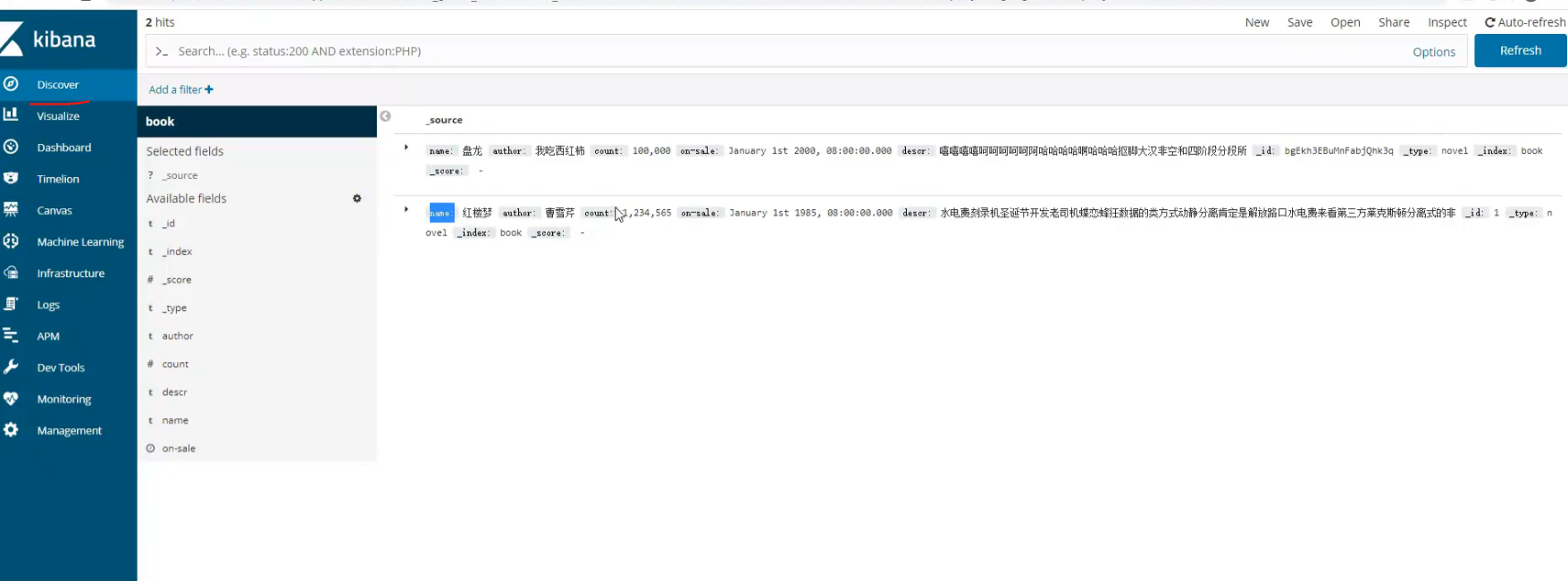

查看数据

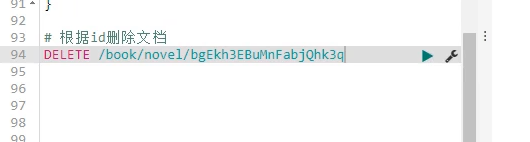

删除文档 直接跟_id